苹果提出的这项基于AR/VR眼动追踪控制工作流程的专利,核心在于利用眼动数据触发事件、检查任务条件、确定人员状态,进而实现工作流程的精准控制,提高结果质量并降低风险。具体内容如下:

眼动数据触发事件苹果专利中,工作流程包含至少一个由人执行的任务,并提供关于特定对象的信息。系统可捕获用户至少一只眼睛的眼动数据,若用户注视预定义对象,便会触发特定操作。例如在维修冰箱场景中,用户注视特定部件,可能触发全息步骤说明,指导用户进行下一步操作。

检查任务条件

系统依赖眼动数据和特定对象信息,检查是否满足任务条件,包括任务是否已执行、是否允许执行。通过人员眼动数据,尤其是对特定对象的眼动数据,监控单个任务是否正确执行。例如直升机飞行员执行任务时,需在特定时间间隔内定期扫描所有仪器,系统根据捕获的眼动数据确定其是否完成任务。若人员看到并确认显示的关键信息,任务才可执行,关键信息从眼动数据分析中得出确认。

确定人员状态

根据捕获的眼动数据确定人员状态,包括情绪、注意力、精神和适合工作状态。基于与眼睛或部分(如瞳孔、眼睑)运动相关的模式,确定用户当前状态,判断执行任务时是否注意力集中。此技术可检查人员是否正确执行任务,如积极注视任务相关对象,或人员是否疲劳、紧张、害怕、分心。

导出位置信息并比较

从眼动数据导出位置信息,与特定对象位置信息比较。基于此导出执行任务人员的大量信息,如是否查看相关对象、是否看到相关信息、是否允许执行任务、是否按预定义顺序或特定时间间隔检查相关对象等,从而判断人员是否正确或允许执行任务。

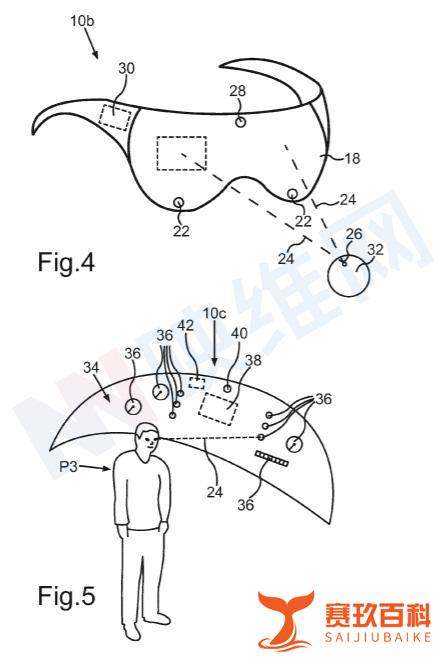

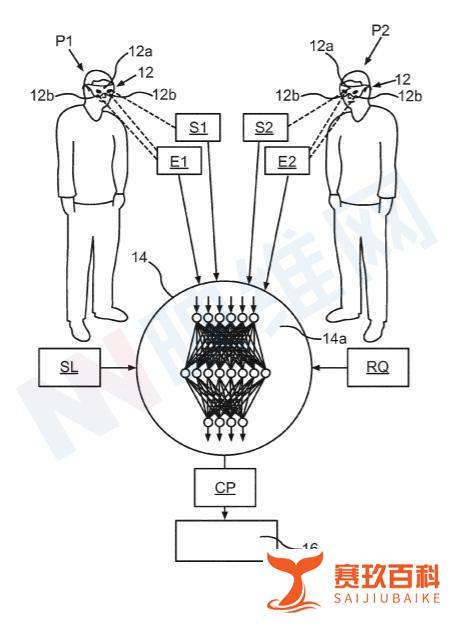

系统构成:系统包括一个或多个头戴式设备,每个设备有场景摄像头和眼动摄像头;处理单元配备神经网络,用于计算控制参数;存储设备存储控制参数。

工作原理:测试人员执行特定任务时佩戴头戴式设备,场景摄像头拍摄场景图像,提供对象信息;眼动摄像头捕获眼动数据,计算注视方向。处理单元接收场景数据和眼动数据,导出测试人员关注环境位置等信息,确定相关对象、任务步骤时间顺序等。通过比较不同测试人员数据验证结果,还可使用技能水平和结果质量信息确定控制参数,存储后用于控制包含特定任务的工作流程。

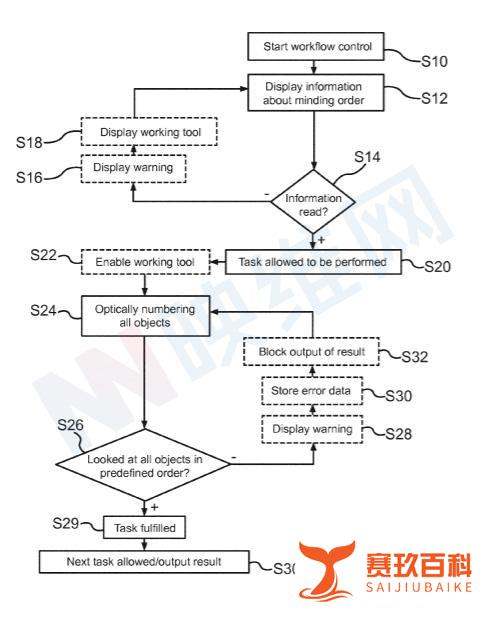

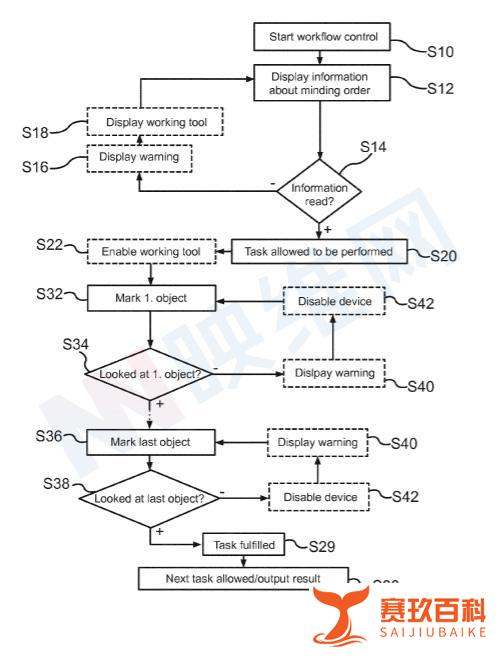

示例性方法流程

相关对象按时间顺序分配给任务单个步骤,如工人按预定义顺序拧紧螺钉,或使用咖啡机时先注水再启动。在显示设备向人员显示信息,通知任务步骤顺序后,检查人员是否阅读信息,通过将注视点与对象位置比较实现。若未阅读,显示警告信息,持续显示注意步骤顺序信息,不允许执行后续操作。若人员按预定顺序查看所有相关对象,认为任务完成。工作流程含多个任务时,对每个任务重复此过程,上一个任务完成才允许下一个任务执行,最后输出任务或工作流程结果。

该专利最初于2021年7月提交,日前由美国专利商标局公布。